嘿,各位AI技术爱好者们!今天咱们就来唠唠一个让圈内炸锅的国产模型——Qwen2.5-Coder!这可不是PPT里吹出来的“潜力股”,而是实打实地在代码领域跟“大佬”们过招,而且还赢面不小!更有意思的是,连微软亚洲研究院都盯上它,还传出了“NextCoder-32B”的“绯闻”,这背后到底藏着什么秘密?赶紧搬好小板凳,我带你一探究竟!

💥 开源!国产模型大集结,Qwen2.5-Coder 霸气登场!

首先得给阿里点个赞!2024年11月,他们一口气开源了六款不同“身材”的 Qwen2.5-Coder 模型(从 0.5B 到 32B),简直是“全家桶”待遇!管你是想在手机上跑个轻量级的,还是想在云端部署个“擎天柱”,总有一款能满足你。

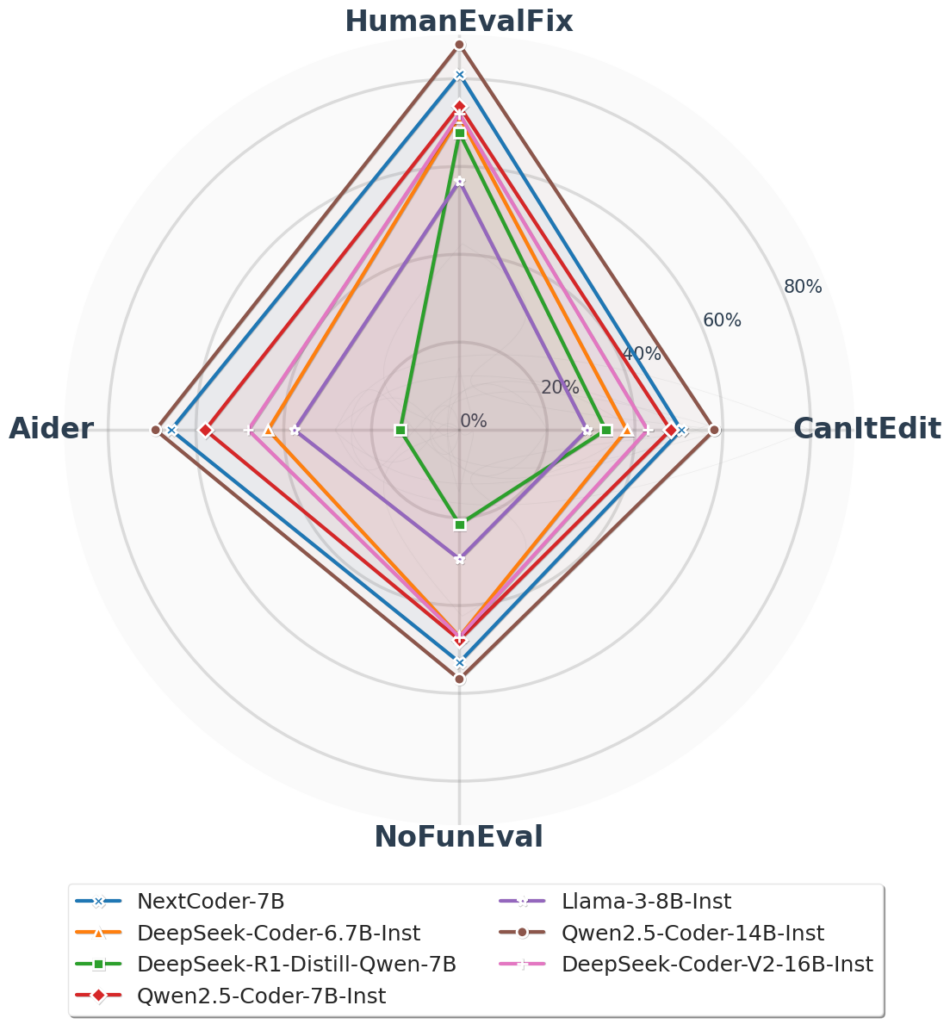

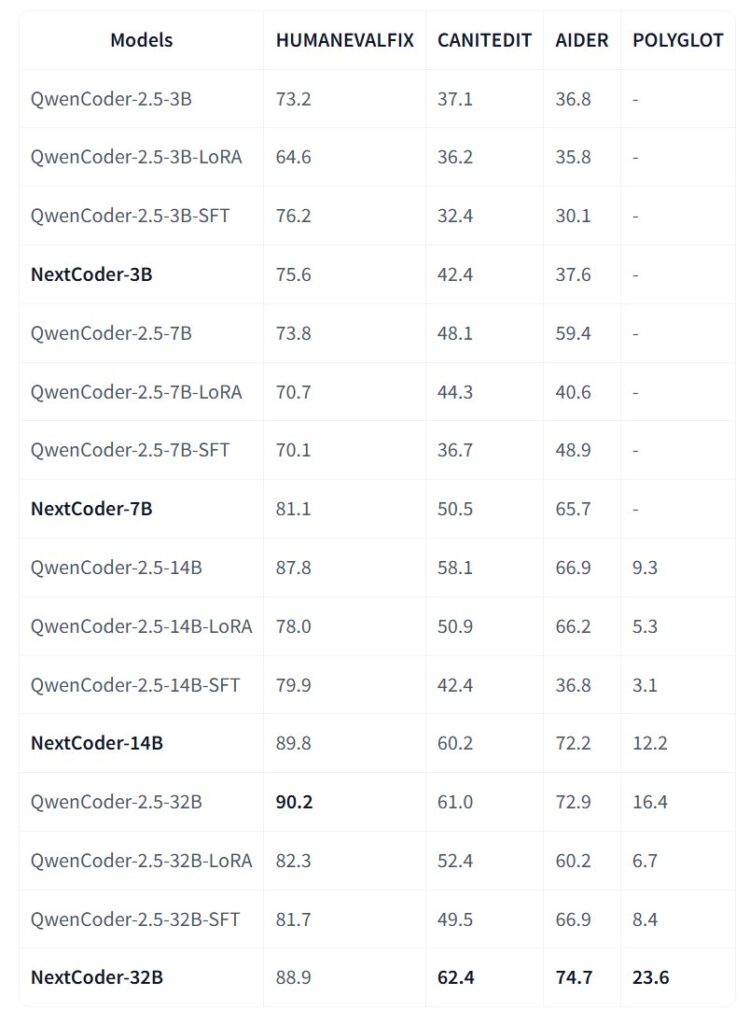

而其中的“扛把子”——Qwen2.5-Coder-32B-Instruct,简直就是开了挂!在十几个硬核的代码基准测试里,它愣是刷新了开源模型的记录,逼近甚至超越了不少闭源巨头。

数据说话,不服来辩!

- 代码生成修复? 在 Aider 测试中,它拿到了 73.7 分,跟 GPT-4o 的 72.9 分几乎是“手拉手”的水平!这意味着它能像个经验丰富的程序员一样,帮你写代码、改 Bug,而且效率还贼高!

- 多语言代码大师? 支持 40+ 种编程语言,这得多炫酷!在 McEval 测试中,它拿到了 65.9 分的最高分,尤其是在 Haskell、Racket 这些“小众但强大”的语言上,表现更是亮眼。

- 代码逻辑推理? 在 CRUXEval-O 基准测试中,它也刷新了开源纪录,这说明它能理解代码背后的逻辑关系,就像个“代码侦探”。

🤝 微软也来“参一脚”?rStar-Coder 项目揭秘!

更令人兴奋的是,微软亚洲研究院盯上了 Qwen2.5-Coder 的潜力,并基于它搞出了一个名为 rStar-Coder 的项目。这怎么理解呢?就像是微软给 Qwen2.5-Coder 喂了一堆“高级饲料”,让它变得更聪明、更强大!

核心亮点是什么?数据!还是高质量的数据!

微软团队构建了一个包含 418K 竞赛级代码问题和 580K 长推理解决方案的数据集。他们用了“三步测试输入生成法”和“相互验证机制”,确保数据的“纯净度”和准确率高达 96.8%!

结果?小模型也能“逆袭”!

微调后的 Qwen2.5-7B,在 LiveCodeBench 上的通过率从 17.4% 直接飙升到 57.3%!14B 版本更是从 23.3% 涨到 62.5%!

最绝的是,在 USACO(美国计算机奥林匹克竞赛)测试中,原本“小巧玲珑”的 7B 模型,竟然以 16.15% 的通过率,超越了那些 32B 级别的模型! 这充分说明了,好数据对模型来说,简直是“点石成金”!

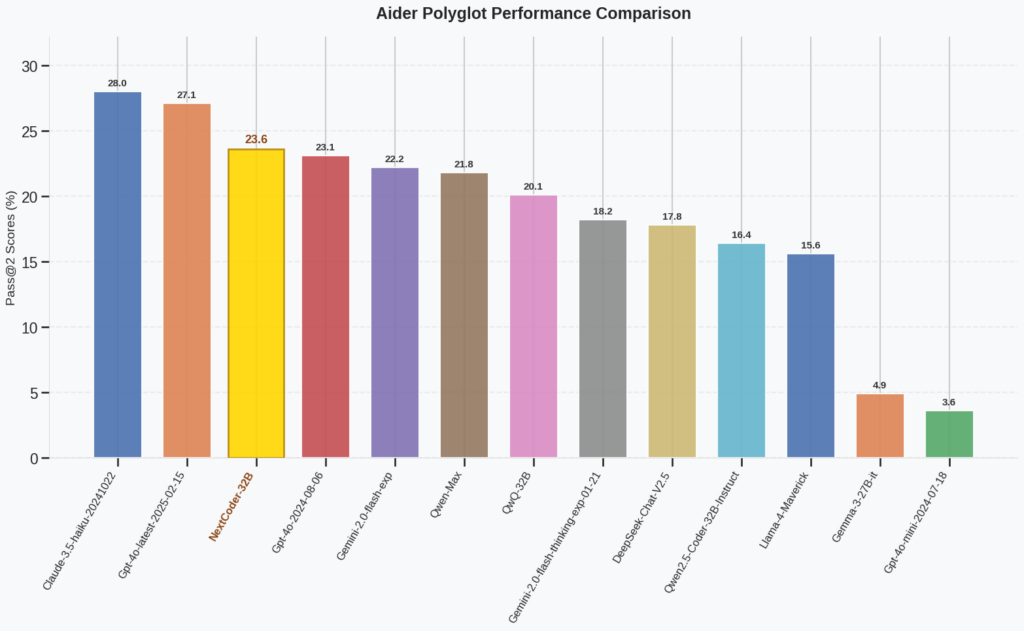

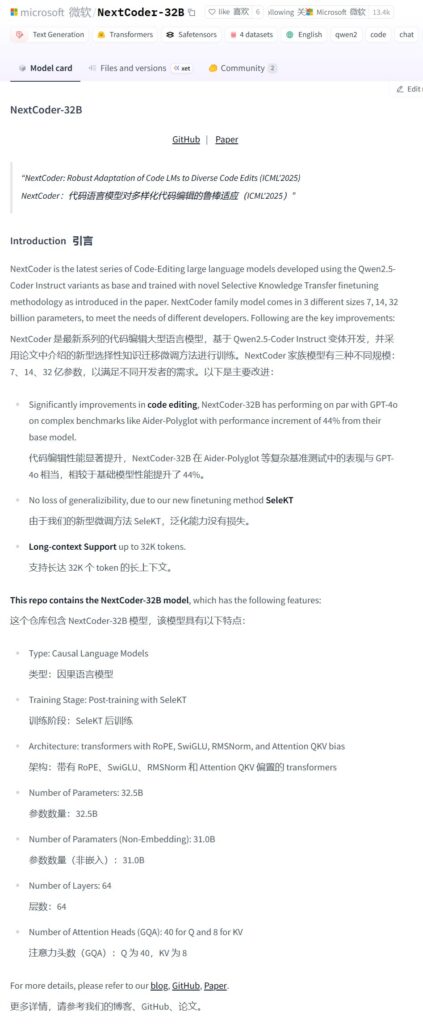

⚠️ “NextCoder-32B” 的乌龙?别被名字带偏了!

你可能会问,那个“NextCoder-32B”是怎么回事?其实啊,目前微软官方并没有推出一个叫做“NextCoder-32B”的模型。这个名字更像是社区对微软这项“基于 Qwen2.5 的优化项目”的一种非正式称呼,或者是个还没公开的项目代号。所以,看到这个名字别被吓到,重点还是看它背后的技术实力!

📊 Aider Leaderboard:实打实的“硬碰硬”

别光听概念,咱们看看实际排行榜是怎么说的。在 Aider 的代码编辑榜单上:

| 模型名称 | 完成率 | 编辑格式符合率 | 对比 GPT-4o |

|---|---|---|---|

| Claude-3.5-Sonnet (20241022) | 84.2% | 99.2% | — |

| Qwen2.5-Coder-32B-Instruct | 73.7% | 100% | 持平/略超 |

| GPT-4o (2024-05-13) | 72.9% | 96.2% | 基准参考 |

| DeepSeek-V2.5 | 72.2% | 96.2% | 略低于 Qwen2.5 |

注意看,Qwen2.5-Coder 不仅在完成率上跟 GPT-4o 打得有来有回,在格式符合度上更是达到了完美的 100%!这说明它的代码规范性一流。

当然,在复杂的项目里,它也还有进步空间,比如在多模块项目中,上下文理解和跨文件逻辑一致性还需要继续打磨。

🚀 未来展望:开源的力量,正在改变代码世界!

总而言之,Qwen2.5-Coder 系列模型的潜力已经被微软这样的巨头看中并进一步挖掘,这本身就说明了它非同小可。rStar-Coder 项目的成功更是为我们展示了高质量数据对模型的重要性,尤其是对那些参数相对较小的模型。

Qwen2.5-32B 在 Aider 等基准测试中能跟 GPT-4o 打得有来有回,这标志着开源模型已经不再是闭源模型的“陪跑”,而是真正成为了行业的“搅局者”!未来,如果能在复杂工程场景下进一步提升鲁棒性,那它对整个代码开发生态的价值,绝对是不可估量的!

让我们一起期待,这些国产的“硬核实力派”能为我们带来更多惊喜吧!别忘了点赞收藏,你的支持是我更新的最大动力! 😉

如果你也对最新的AI信息感兴趣或者有疑问 都可以加入我的大家庭 第一时间分享最新AI资讯、工具、教程、文档 欢迎你的加入!!!😉😉😉

公众号:墨风如雪小站

文章评论