老实说,在AI绘画圈子里摸爬滚打了这么久,大家是不是都有点审美疲劳了? 不管是用哪个主流模型,跑多了你总能发现某种“诡异的默契”:千篇一律的完美光影,像是同一个整容医生刀下的“网红脸”,还有那种一眼就能看穿的塑料质感。这种“同质化”就像是AI绘画头顶的一层玻璃天花板,好看是好看,但总觉得少了点灵魂。 不过,就在2026年1月28日,阿里云通义团队搞了个大动作,开源了名为 Z-Image 的基座模型。看完这波技术细节,我感觉这层天花板可能要被敲出裂缝了。 不止是快,更重要的是“原生” 这次发布的 Z-Image 是一…

嘿,各位AI圈的朋友们,还记得那些年我们被数据报表支配的恐惧吗?那些需要“人肉”筛选、分析、解读,甚至熬夜赶制报告的日子,如今似乎真的要成为历史了!2025年8月28日,阿里巴巴旗下瓴羊公司扔出了一颗重磅炸弹:Quick BI中的“智能小Q”完成了史诗级进化,摇身一变,成为了一个由问数、解读、报告三大核心Agent组成的“超级数据分析师”!更令人兴奋的是,这套完整的Agent能力将在2025年9月9日全面向所有企业用户开放。 这可不仅仅是技术上的小修小补,这简直是给所有业务决策者和数据分析师装上了“涡轮增压器”,它…

曾几何时,我们以为AI绘画的终点是“以假乱真”。但很快,所有内容创作者和设计师都遇到了同一个瓶颈:AI能画出完美的图,却改不好一张图。仅仅是想把海报上的“夏季大促”改成“秋季上新”,就足以让最先进的模型束手无策,要么文字扭曲,要么风格尽毁。 这个创作流程中的“最后一公里”,似乎成了一道天堑。直到2025年8月19日,阿里巴巴通义千问团队将一块重磅拼图——Qwen-Image-Edit,放在了世界的桌面上。它似乎在说:从现在起,图像编辑不再是祈祷和妥协,而是精准的对话。 不只是听懂,更是“看懂”:双脑驱动的编辑革命 …

在AI界,“参数为王”的信仰似乎坚不可摧,巨头们在千亿、万亿参数的军备竞赛中一路狂奔。然而,阿里国际数字贸易集团(AIDC)最近却悄然扔出了一枚“深水炸弹”——Ovis2.5。它没有夸张的参数规模,却用一种近乎“降维打击”的方式,重新定义了什么叫“经济型高性能”。 这不仅仅是一个模型的迭代,更像是一场理念的革命。 告别“裁剪与平铺”,让AI拥有原生视力 想象一下,当你让一个AI分析一张复杂的工程图纸时,它做的第一件事是什么?传统模型会粗暴地把图片切成一个个小方块,或者直接压缩,就像让你透过一堆马赛克去理解《清明上河…

在AI绘画的浪潮中,我们见证了太多奇迹:一句话生成一座赛博朋克都市,一个词绘出一片梵高星空。但在这片繁华之下,一直有个令人啼笑皆非的“老大难”问题——AI不会写字。 你让它画个“开业大吉”的招牌,它可能给你“开吉大业”;你想要一句“清风徐来”,它却生成一堆形似而非的乱码。这种“文盲”式作画,让我们在赞叹其想象力的同时,也对其基本功感到无奈。我们似乎默认了,AI的画笔,挥洒的是艺术,而非文字。 直到现在,阿里巴巴通义千问团队带着 Qwen-Image 走来,大声宣布:这个时代结束了。 不只是“能写”,而是“会写”的降…

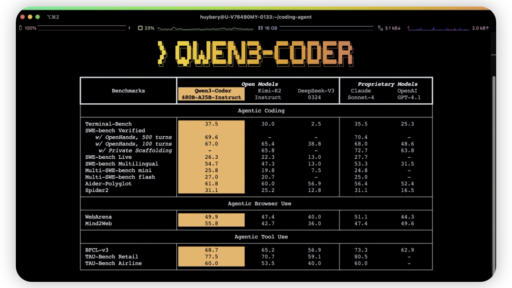

AI编码的江湖,风云再起。 当我们还在讨论各种模型谁的代码补全更丝滑时,阿里通义千问团队直接掀了桌子,扔出了一枚重磅炸弹:Qwen3-Coder-480B-A35B-Instruct。别被这长长的名字吓到,你可以简单地理解为,一个为“代理编码”(Agentic Coding)而生的开源巨兽,正向我们走来。 这头“巨兽”有多庞大? 首先,我们得聊聊它的体格,这实在令人印象深刻。 它是一个拥有4800亿总参数的混合专家(MoE)模型。这是什么概念?意味着它的知识库和潜在能力是极其浩瀚的。但更巧妙的是,它在工作时并不需要…

你是否已经厌倦了千篇一律、毫无感情的AI语音?现在,改变的时刻到了!阿里巴巴通义千问团队重磅发布了全新的语音生成模型——Qwen-TTS,它不仅能说一口流利的中英双语,更能“飚”起地道的方言,让你的AI从此有了乡音、有了情感、有了“人味儿”! 核心亮点:不止普通话,更是家乡话 Qwen-TTS 本次最令人惊艳的突破,莫过于对三种特色中文口音的精准还原: 地道京味儿(音色: Dylan): “那都不是事儿!”一口纯正的京腔,带着标志性的儿化音,无论是讲故事还是侃大山,都京味儿十足。 吴侬软语(音色: Jada): “…

在数字世界和现实边界日益模糊的今天,数字人早已不再是科幻电影中的专属。从虚拟主播到AI客服,它们正逐渐渗透进我们的日常生活。然而,高质量3D数字人的高昂成本和复杂技术门槛,曾让许多创意和应用止步不前。但现在,阿里巴巴携Mnn3dAvatar重磅开源,无疑给整个行业投下了一枚“重磅炸弹”——它正以一种前所未有的方式,让3D数字人真正普惠化! 解锁数字人的“魔法”:轻量化与实时性 Mnn3dAvatar,这个听起来有些拗口的名字背后,藏着阿里对3D数字人技术未来的一次大胆诠释。它基于阿里自研的轻量级深度学习框架MNN(…

2025年5月29日,阿里巴巴在GitHub上正式开源其自主搜索AI智能体WebAgent,引发了业界对端到端自主信息检索与多步推理能力的广泛关注。这一举措标志着国内科技巨头在AI智能体领域的技术探索迈出了坚实一步,为开发者提供了前沿的研究与应用平台。 一、核心架构与功能设计 WebAgent旨在模拟人类在网络环境中的感知、决策和行动循环,支持智能体自主访问、筛选、整合信息,并生成结构化报告。其核心由两大模块组成: WebDancer:端到端智能体训练框架。专注于提升智能体的多步骤网络信息搜索能力,涵盖从高质量数据…

大语言模型(LLM)的能力提升,似乎一直在遵循一条“越大越好”的定律——参数量越多,模型在各种任务上表现越强。然而,“大”模型带来了巨大的计算和显存开销,让许多研究者和开发者望而却步。近期,Qwen团队提出了一个令人耳目一新的解决方案:ParScale,它另辟蹊径,通过创新的“并行推理”方法,在不显著增加模型参数的情况下,显著提升模型性能。 ParScale:一种全新的扩展范式 传统上,提升模型能力主要依靠两种方式:一是增加参数量(模型变大),二是增加推理计算深度(比如多次迭代或思维链)。ParScale则引入了“…