想象一下,你的笔记本电脑不再仅仅是办公工具,而是拥有了像AI助手一样的智慧!近日,微软悄然发布了一款名为 Phi-4-mini-flash-reasoning 的小型语言模型(SLM),它就像AI界的“变形金刚”,将强大的推理能力浓缩进轻巧的机身,专为我们身边的设备而生。

🧠 小身材,大能量:3.8亿参数的“硬核玩家”

别看它只有 38亿个参数,这可是一个精心雕琢的“麻雀虽小,五脏俱全”的典范!微软用高质量的合成数据,特别是针对那些需要步步为营的数学和逻辑推理任务进行了深度打磨。结果如何?在 AIME24/25、Math500 等严苛的基准测试中,它的表现甚至超越了一些体型大出它两倍的“大哥们”,简直是AI界的“逆袭剧本”!

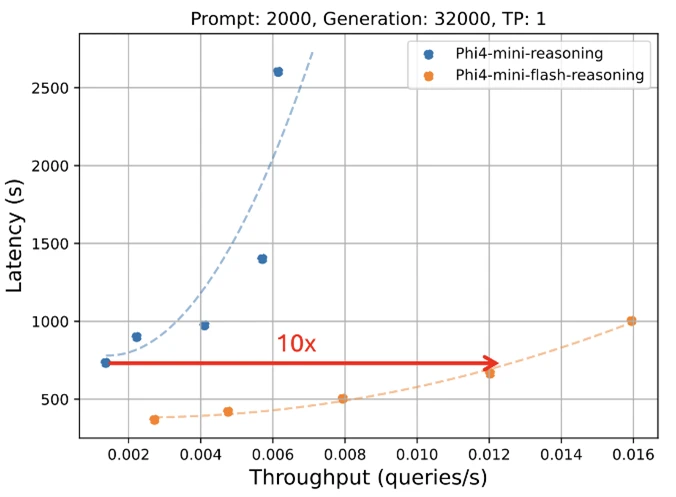

⚡ 速度与激情:10倍吞吐量,延迟低至1/3!

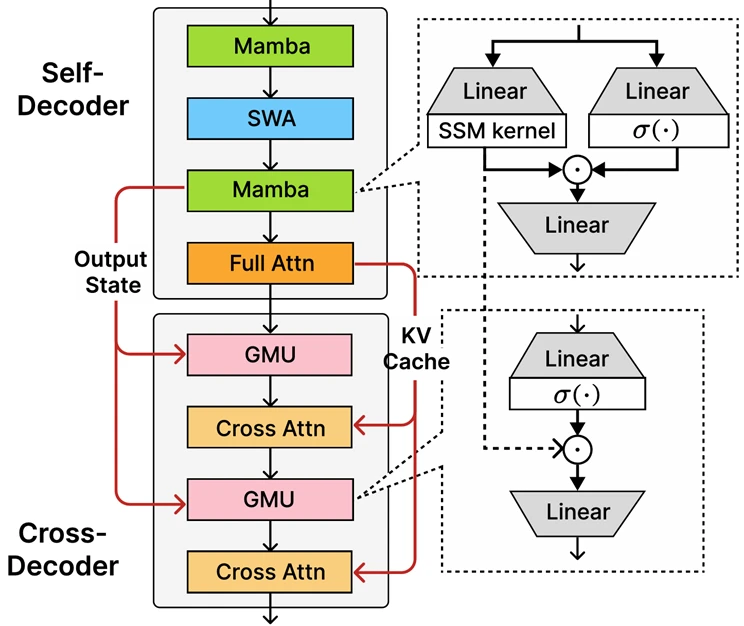

是不是觉得AI模型总是慢吞吞的?Phi-4-mini-flash-reasoning 要打破这个认知!它采用了革命性的 SambaY架构,融合了Mamba、滑动窗口注意力和创新的GMU组件,让信息传递如行云流水。

这意味着什么?简单来说,它的 吞吐量提升了惊人的10倍,意味着它能同时处理更多任务或生成更多内容;而 平均延迟则降低了2到3倍,让AI的响应快如闪电!无论是实时辅导、智能助手还是复杂问题的解答,它都能给你一个满意的“秒回”。

💻 边缘AI的未来:笔记本、平板都能畅快运行

Phi-4-mini-flash-reasoning 最激动人心的地方在于它的 “端侧”属性。它不需要你拥有顶级的服务器或昂贵的GPU,一块 消费级GPU(如RTX 3060)甚至CPU就能让它跑起来。这意味着你的笔记本电脑、平板设备,甚至是一些嵌入式系统,都能成为强大的AI推理平台。教育、医疗、工业等领域的智能化应用,都将因此变得触手可及,而且更重要的是,你的数据将留在本地,隐私得到充分保障,完美契合微软的负责任AI原则。

📚 玩转AI,微软给你“工具箱”

想让这个“AI神器”为你所用?微软也为开发者准备了丰富的资源。模型已在 Azure AI Foundry 和 Hugging Face 平台开源,你可以轻松获取和部署。更棒的是,它还支持 Function Calling,可以调用外部API实现更多实用功能,甚至可以通过LoRA技术扩展多模态能力!

💡 总结:AI正在加速走进你的生活!

微软的 Phi-4-mini-flash-reasoning 不仅仅是一个AI模型,它更是 边缘AI领域的一个重要里程碑。它证明了即使是轻量级的模型,也能在性能上带来颠覆性的突破,让强大的AI能力更广泛地惠及每个人、每台设备。

准备好让你的设备“聪明”起来了吗?Phi-4-mini-flash-reasoning,就是那个让你梦想照进现实的钥匙!

如果你也对最新的AI信息感兴趣或者有疑问 都可以加入我的大家庭 第一时间分享最新AI资讯、工具、教程、文档 欢迎你的加入!!!😉😉😉

公众号:墨风如雪小站

文章评论