最近AI圈子真是热闹非凡,各家大模型你方唱罢我登场,拼参数、拼算力、拼数据。但要说最近让我眼前一亮的,那非小红书 Hi Lab 在 2025年6月6日 正式开源的 dots.llm1-143B-A14B(简称 dots.llm1)莫属了!这不只是一款“硬核”的MoE大模型,更是一款带着“人文温度”的智能体,让人不得不感叹,AI真的越来越有意思了!

小身板大能量:MoE架构,训练成本“打骨折”!

别看名字有点长,它背后的技术可一点不含糊。dots.llm1 采用了时下最火的 MoE(Mixture of Experts)稀疏架构。啥意思呢?简单来说,模型里藏着一大堆“小专家”,每次处理信息时,系统只会激活其中最擅长的几个专家来干活,而不是让所有参数都参与运算。

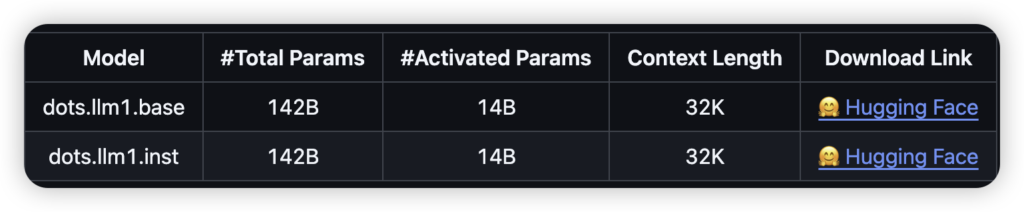

- 总参数量高达1420亿(142B),但实际激活的参数只有 140亿(14B)。这就像一个有100个脑子的人,但每次只用10个脑子来思考问题,效率直接拉满!

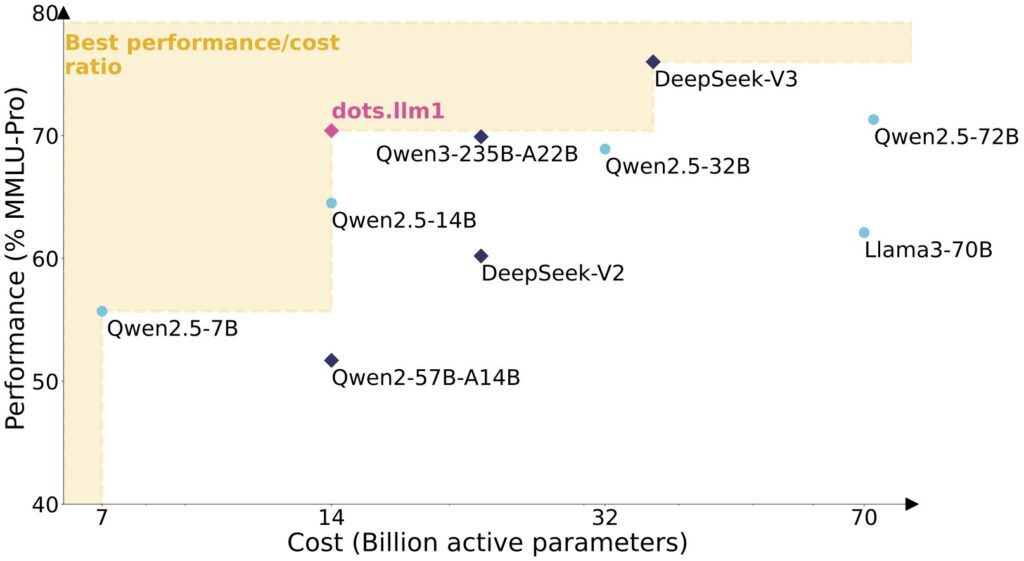

- 训练数据仅用了11.2万亿(T)高质量真实语料,一个合成数据都没用,结果呢?性能媲美 Qwen2.5-72B!

- 最让人惊叹的,是它的“省钱”能力! 训练资源总消耗仅需 146万GPU小时,不到 Qwen2.5-72B(612万GPU小时)的 1/4!每万亿 token 的训练成本更是低至 13万GPU小时,而 Qwen2.5 却要 34万。这简直是把训练成本打了个骨折啊!

它还支持 32K tokens 的超长上下文,通过独特的 UtK(Unshuffle-then-Knit)策略,能巧妙处理长文本,让模型在“记忆力”上不输阵。

中文赛道领跑者:不只优秀,简直“开挂”!

性能如何?这是大家最关心的!dots.llm1 在多个基准测试中表现都非常亮眼,尤其在中文任务上,简直是“开挂”般的存在!

- 中文语义理解(CLUEWSC):92.6分,这可是行业领先的水平!

- 中文综合能力(C-Eval):92.2分,直接超越了 DeepSeek-V3 等一众主流大模型,太给力了!

- 数学推理(MATH500):84.8分,甚至跑赢了 Qwen2.5 系列,在数学方面也是一把好手。

虽然在英文任务上与 Qwen2.5-72B 相当,代码能力略逊于 Qwen3 和 DeepSeek-V3,但这并不妨碍它成为中文大模型领域的一颗耀眼新星。要知道,这还是在更低成本、更少数据训练出来的成果,潜力无限!

不仅智能,更有人文:Hi Lab的“AI人文训练师”

如果说前面是“硬实力”,那这一部分就是 dots.llm1 的“灵魂”所在了。小红书的 “人文智能实验室”(Hi Lab)不只追求极致的AI能力,更将“人文”的温度融入其中。

- 他们组建了一支独特的 “AI人文训练师”团队!想象一下,一群拥有哲学、文学、电影艺术背景的专家,亲自上手调教AI,这听起来是不是有点像科幻电影里才能看到的场景?

- 他们甚至与 复旦大学哲学学院 合作,成立了 “AI人文人才训练营”,旨在培养更多能把AI和人文结合起来的跨学科人才。

- 通过这种“人文微调”——包括指令微调和拒绝采样微调(RFT),模型的输出会更像人类,少一些“AI味儿”,多一些温度和深度,在伦理思辨、人性化表达上,努力向人类看齐。这无疑是AI发展中极其重要的一步。

慷慨开源,共创未来:不止代码,还有“学习笔记”!

小红书这次是真的“敞亮”!dots.llm1 可是带着满满的诚意,以 MIT许可证 全面开源:

- 代码和权重 已在 Hugging Face 和 GitHub 上公开,伸手可得。

- Hugging Face:https://huggingface.co/rednote-hilab

- GitHub:https://github.com/rednote-hilab/dots.llm1

- 更让人惊喜的是,他们还公开了预训练阶段每 1T token 的中间检查点!这对于想深入研究大模型学习动态、理解训练过程的开发者和研究者来说,简直是雪中送炭,一份无比珍贵的“学习笔记”!

总结:AI圈的新范式,值得期待!

dots.llm1-143B-A14B 的发布,不仅仅是小红书在AI领域投下的一枚重磅炸弹,它更像是一种全新的范式:用高效的MoE架构实现低成本高性能,再结合人文微调提升生成内容的“人味儿”。

尤其是它在中文任务上的卓越表现和对“人文智能”的深度探索,让 dots.llm1 有望成为国产开源大模型的新竞争力标杆。Hi Lab 的成立,以及技术负责人陈威行这样的核心人物坐镇,都表明小红书对AI的投入是全方位的、深远的。

所以,各位开发者、研究员,还在等什么?赶紧去Hugging Face和GitHub一探究竟吧!这款中文MoE的“人文”突破,绝对值得你深入体验!

如果你也对最新的AI信息感兴趣或者有疑问 都可以加入我的大家庭 第一时间分享最新AI资讯、工具、教程、文档 欢迎你的加入!!!😉😉😉

公众号:墨风如雪小站

文章评论